Est-ce l’avenir des vêtements assortis ? Google dit que c'est le cas

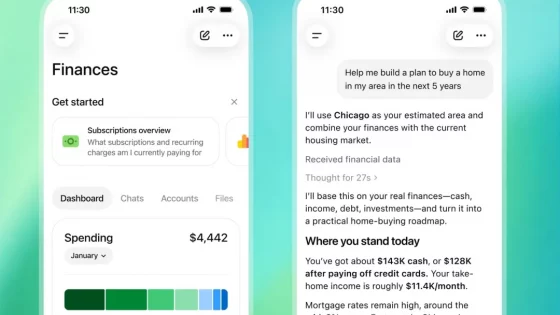

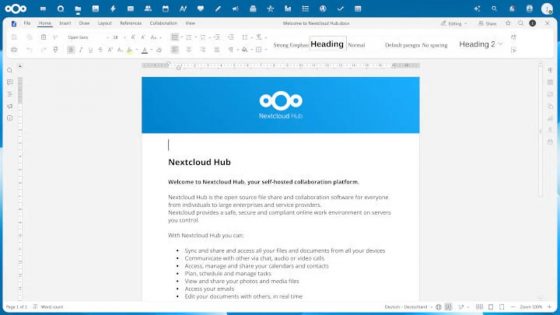

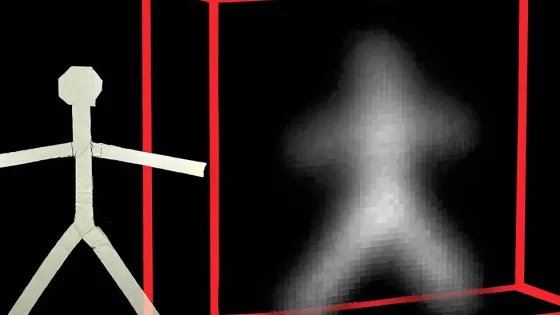

L'outil d'essayage virtuel de vêtements de Google, qui fait partie d'une large gamme de mises à jour de Google Shopping prévues dans les prochaines semaines, prend une image d'un vêtement et tente de prédire comment il va rouler, se plier, s'ajuster, s'étirer et former des plis et des ombres — sur un ensemble de modèles humains réels dans différentes positions.

Les tests virtuels s'appuient sur un nouveau modèle d'intelligence artificielle basé sur la diffusion. Développé en interne par Google, ce modèle repose sur l'apprentissage progressif de modèles de diffusion, dont les plus connus sont les générateurs de texte à partir d'images Stable Diffusion et DALL-E 2. Ces modèles apprennent à éliminer graduellement le bruit d'une image initiale entièrement bruitée, la rapprochant ainsi progressivement de la cible.

Google a entraîné le modèle à l'aide de plusieurs paires d'images, chacune présentant une personne portant le vêtement dans deux poses différentes : par exemple, une image d'une personne portant une chemise de profil et une autre image où le modèle est de face. Afin de rendre le modèle plus robuste (c'est-à-dire moins sensible aux erreurs visuelles telles que les plis qui paraissent déformés et artificiels), le processus a été répété avec des paires d'images de vêtements et de personnes sélectionnées aléatoirement.

Pendant environ un mois, les utilisateurs américains de Google Shopping peuvent essayer virtuellement des t-shirts pour femmes de marques comme Anthropologie, Everlane, H&M et LOFT. Un nouveau badge « Essayer » est disponible sur la recherche Google. Les t-shirts pour hommes seront disponibles plus tard cette année.

« Quand on essaie des vêtements en magasin, on peut immédiatement savoir s’ils nous vont bien », a-t-il déclaré. Lilian Rincón, directeur principal des produits d'achat grand public chez Google, a écrit dans un article de blog. Il cite des recherches montrant que 42 acheteurs en ligne de % pensent que les modèles dans les magasins en ligne ne représentent pas la réalité, tandis que 59 % se sentent insatisfaits d'un produit qu'ils ont acheté en ligne parce qu'il leur paraissait différent de ce à quoi ils s'attendaient.

Essayer virtuellement des vêtements n’est pas une nouveauté. Amazon et Adobe expérimentent depuis un certain temps la modélisation générative des vêtements, tout comme Walmart, qui propose depuis l'année dernière une fonctionnalité en ligne utilisant les photos des clients pour modéliser les vêtements.

Google a déjà testé l'essayage virtuel de vêtements et s'est associé à L'Oréal, Estée Lauder, MAC Cosmetics, Black Opal et Charlotte Tilbury pour permettre aux utilisateurs de rechercher des teintes de maquillage sur des mannequins aux carnations variées. L'intelligence artificielle générative est de plus en plus utilisée dans l'industrie de la mode, mais elle suscite l'opposition de mannequins qui affirment qu'elle exacerbe les inégalités profondément ancrées dans ce secteur.

Dans un article de blog, Rincon a souligné que Google avait choisi de faire appel à de vrais mannequins, et à une sélection diversifiée allant de la taille XXS à 4XL, représentant une variété d'origines ethniques, de teints, de morphologies et de types de cheveux. Cependant, elle n'a pas répondu à la question de savoir si cette nouvelle fonctionnalité d'essayage virtuel réduirait les possibilités de photographier des mannequins à l'avenir. Parallèlement au lancement de l'essayage virtuel, Google introduit également des options de filtrage pour la recherche de vêtements. Et comme vous l'aurez deviné, cette fonctionnalité repose elle aussi sur l'intelligence artificielle et des algorithmes de reconnaissance visuelle.