È questo il futuro degli abiti coordinati? Google dice di sì

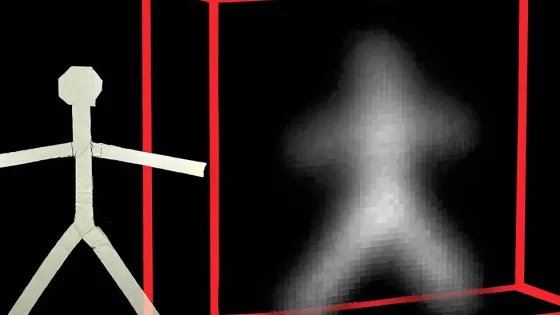

Lo strumento virtuale di Google per provare i vestiti, parte di una vasta gamma di aggiornamenti di Google Shopping in arrivo nelle prossime settimane, scatta un'immagine di un capo di abbigliamento e tenta di prevedere come si arrotolerà, si piegherà, si adatterà, si allungherà e formerà pieghe e ombre, su una serie di modelli umani reali in diverse posizioni.

I test virtuali si basano su un nuovo modello di intelligenza artificiale basato sulla diffusione, sviluppato internamente da Google. I modelli di diffusione, i più noti dei quali sono i generatori di testo-immagine Stable Diffusion e DALL-E 2, imparano a rimuovere gradualmente il rumore da un'immagine iniziale interamente composta da rumore, avvicinandola gradualmente al target.

Google ha addestrato il modello utilizzando diverse coppie di immagini, ciascuna delle quali includeva una persona che indossava l'indumento in due pose diverse, ad esempio un'immagine di qualcuno che indossava una maglietta in posizione laterale e un'altra in cui il modello era in posizione frontale. Per rendere il modello più robusto (ovvero resistente a errori visivi come rughe che appaiono distorte e innaturali), il processo è stato ripetuto utilizzando coppie casuali di immagini di abiti e persone.

Per circa un mese, gli acquirenti negli Stati Uniti che utilizzano Google Shopping potranno provare virtualmente magliette da donna di marchi come Anthropologie, Everlane, H&M e LOFT. Un nuovo badge "Try On" è disponibile su Ricerca Google. Le magliette da uomo saranno disponibili entro la fine dell'anno.

"Quando provi i vestiti in un negozio, capisci subito se sono adatti a te", ha affermato. Lilian Rincon, direttore senior dei prodotti per lo shopping di consumo di Google, ha scritto in un post sul blog. Cita una ricerca che mostra che 42 acquirenti online di % ritengono che i modelli nei negozi online non rappresentino l'immagine reale, mentre 59 % si sentono insoddisfatti di un prodotto acquistato online perché sembrava diverso da quello che si aspettavano.

Provare virtualmente i vestiti non è una novità. Amazon e Adobe stanno sperimentando da tempo la modellazione generativa di abbigliamento, così come Walmart, che dallo scorso anno offre funzionalità online che utilizzano le foto dei clienti per modellare gli abiti.

Google ha già testato la prova virtuale di abiti e ha collaborato con L'Oréal, Estée Lauder, MAC Cosmetics, Black Opal e Charlotte Tilbury per consentire agli utenti di cercare tonalità di trucco su modelle con diverse tonalità di pelle. L'intelligenza artificiale generativa è sempre più utilizzata nel settore della moda e ha incontrato l'opposizione delle modelle, che affermano che esacerba le disuguaglianze di lunga data nel settore.

In un post sul blog, Rincon ha sottolineato che Google ha scelto di utilizzare modelli reali, con una selezione diversificata che spazia dalle taglie XXS alla 4XL e rappresenta una varietà di etnie, tonalità di pelle, corporature e tipi di capelli. Tuttavia, non ha risposto alla domanda se la nuova funzione di prova comporterà una riduzione delle opportunità di fotografare modelli in futuro. Insieme al rilascio della funzione di prova virtuale, Google sta anche introducendo opzioni di filtro per le ricerche di abbigliamento. Sì, avete indovinato, anche questa è basata sull'intelligenza artificiale e sugli algoritmi di corrispondenza visiva.