Google DeepMind predstavlja generalistički model koji pomiče granice računalnog vida

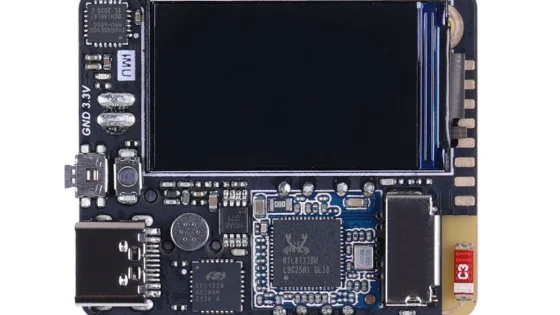

Istraživački tim Google DeepMind-a pokazao je s modelom Vision Banana da prekursori generiranja slika služe kao snažan temelj za opće razumijevanje vizualnog svijeta, slično kao što modeli velikih jezika (LLM) razvijaju razumijevanje jezika putem predviđanja sljedeće riječi. Sustav se temelji na Nano Banana Pro-u, Googleovom najnaprednijem generatoru slika, koji je transformiran u Vision Banana putem laganog učenja temeljenog na instrukcijama. Ključna inovacija je da su različiti zadaci računalnog vida, poput segmentacije, određivanja dubine i procjene normale površine, transformirani u zadatke generiranja RGB slika.

Vision Banana postigao je vrhunske rezultate u takozvanim okruženjima „zero-shot“, gdje model nema prethodnog iskustva sa specifičnim skupovima podataka. Nadmašio je model SAM 3 u segmentaciji slike, postigavši metrički rezultat dubine od 0,929 (parametar δ1), pobijedivši prethodnog rekordera Depth Anything V3 (0,918). Posebno je impresivno da model ne zahtijeva nikakve podatke o parametrima kamere za određivanje dubine, što je do sada bila glavna prepreka za takve sustave.

Ovaj pristup pruža tri ključne prednosti. Jedan model gdje jedna neuronska mreža može obavljati širok raspon zadataka, a mijenja se samo tekstualni upit. Za prilagodbu modela bila je potrebna samo mala količina specifičnih vizualnih podataka. Nadalje, unatoč novim analitičkim mogućnostima, Vision Banana i dalje u potpunosti zadržava svoju izvornu funkciju generiranja vrhunskih fotorealističnih slika.

Istraživači vjeruju da svjedočimo promjeni paradigme gdje će generativno predučenje postati standard za izgradnju općih vizualnih modela budućnosti. Vision Banana nije samo novi alat, već dokaz da sposobnost stvaranja vizualnog sadržaja implicitno zahtijeva duboko razumijevanje geometrije, semantike i prostornih odnosa u stvarnom svijetu.